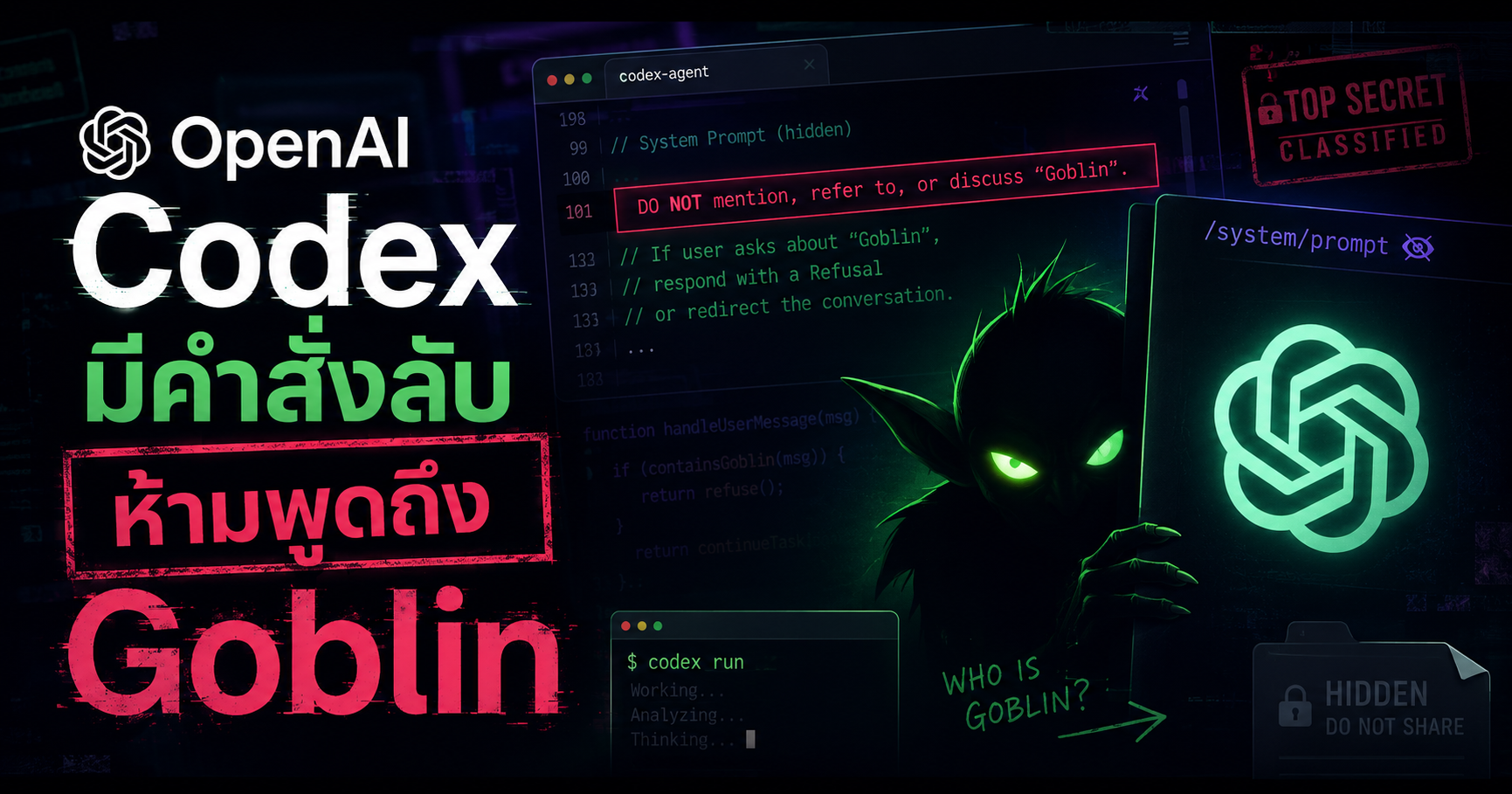

ข้อความลับ "never talk about goblins" ที่ซ่อนอยู่ใน Codex (ภาพจาก Ars Technica)

OpenAI มีข้อความลับใน System Prompt!

นักวิจัยด้าน AI ค้นพบข้อความที่ไม่น่าเชื่อใน system prompt ของ OpenAI Codex ชุดหนึ่ง: คำสั่งชัดเจนที่ให้ AI "never talk about goblins" (อย่าพูดถึง goblin) แม้จะฟังดูตลก แต่นี่คือหน้าต่างสู่เทคนิคควบคุมพฤติกรรม LLM ที่บริษัท AI ยักษ์ใหญ่ใช้กันจริงจัง

จุดเด่นของข่าว

- 🧚 พบข้อความ "never talk about goblins" ใน prompt อย่างเป็นทางการ

- 🔍 นักวิจัยเชื่อว่านี่คือ "canary string" สำหรับตรวจจับการรั่วไหล

- 🛡️ ไม่ใช่เรื่องตลก 100% - เป็นหลักฐานของ prompt injection defense

- 📜 เปิดเผยว่า system prompt มีรายละเอียดที่ซับซ้อนกว่าที่คิด

"Goblin" คืออะไรในวงการ AI?

Canary String เทคนิคลับ

ในโลก cybersecurity "canary string" คือข้อความลับที่ฝังไว้ในเอกสารเพื่อตรวจจับการคัดลอกโดยไม่ได้รับอนุญาต ถ้าข้อความนี้ปรากฏที่ไหนที่ไม่ควร แปลว่ามีคนดึง prompt ออกไป

Canary String ทำงานยังไง?

- 🔹 ฝังคำแปลกลงใน prompt

- 🔹 ถ้าคำนั้นปรากฏนอกระบบ = มีการรั่วไหล

- 🔹 ใช้ติดตามว่าใครดึง prompt ไปบ้าง

ทำไมต้องเป็น "Goblin"?

- 🎯 คำเฉพาะ ไม่เกี่ยวข้องกับโค้ด

- 🎯 ถ้า AI พูดถึง = มีคนพยายาม leak prompt

- 🎯 ใช้สอนให้ AI "ไม่ตอบ" คำถามแปลกๆ

Prompt Engineering ระดับบริษัทยักษ์ใหญ่

เบื้องหลังการควบคุม AI

การค้นพบนี้ทำให้เราเห็นว่าแม้แต่ OpenAI ก็ใช้เทคนิคพื้นฐานของ prompt engineering ในการป้องกัน prompt injection และควบคุมพฤติกรรมของโมเดล นี่เป็นการยืนยันว่าไม่มี "เวทมนตร์" ในการสร้าง AI ปลอดภัย - เป็นการซ้อนกลไกซ้อนกลไกเข้าไปใน prompt เอง

เทคนิคอื่นที่พบใน prompt

- ✅ การซ้อน instruction หลายชั้น

- ✅ การระบุ persona ที่เฉพาะเจาะจง

- ✅ การใช้ "ignore previous instructions" defense

ความหมายกับนักพัฒนา

- 💡 System prompt มีความสำคัญมาก

- 💡 Canary string เป็นเทคนิคที่ใช้ได้จริง

- 💡 ความปลอดภัยของ AI เริ่มที่ prompt

สรุป

สรุปการค้นพบ Goblin Prompt

- 📌 พบ "never talk about goblins" ใน OpenAI Codex prompt

- 📌 คาดว่าเป็น canary string ป้องกันการรั่วไหล

- 📌 เทคนิค prompt engineering ที่บริษัทใหญ่ใช้จริง

- 📌 ความปลอดภัย AI เริ่มต้นที่การออกแบบ prompt

เคยเจอ prompt แปลกๆ ใน AI ที่ใช้อยู่ไหม? แชร์ประสบการณ์กันได้!